看任何片,不論是歐美大片,還是國語經典,甚至是語言不可描述的影片,字幕都是不可缺少的一環。

過去看粵語片,其他地區聽不懂覺得要個字幕很正常,但普通話爲啥還要字幕呢?過去就很納悶。但接觸到的人越來越多,發現地域差異與方言影響,以及大家聽覺感知的個體差異後,也能夠慢慢理解了。

再有就是,部分朋友可能還會做做自媒體。字幕在自媒體時代的作用已經遠不止“輔助聽力”那麼簡單,它已經成爲增強觀衆粘性、提升觀看體驗、甚至塑造內容風格的重要工具。如果你打算認真做自媒體視頻,字幕一定要系統性規劃,並且可以考慮早早引入一些自動化工具。

那咱們本期就來介紹這麼一款🐮🍺的開源自動字幕生成工具,卡卡字幕助手(VideoCaptioner)。

這個項目其實去年年底就有羣友發現並推薦,但當時測試體驗感覺就是準確率高一些外也沒啥別的特色。最近恰巧有位羣友問,有沒有那種影片的字幕生成工具。。。我一下子就給想起來了~時隔四個月的更新現在已經非常贊,因此來介紹給大家。

目前卡卡字幕有Windows客戶端(完整強大免費),也支持Docker一鍵部署超級輕量版(網頁版限制視頻大小200MB,語種有限)。

項目介紹

卡卡字幕助手(VideoCaptioner)操作簡單且無需高配置,支持網絡調用和本地離線(支持調用GPU)兩種方式進行語音識別,利用可用通過大語言模型(open Ollama DeepSeek等 )進行字幕智能斷句、校正、翻譯,字幕視頻全流程一鍵處理!爲視頻配上效果驚豔的字幕。

最新版本已經支持 VAD 、 人聲分離、 字級時間戳 批量字幕等實用功能

🎯 無需GPU即可使用強大的語音識別引擎,生成精準字幕

✂️ 基於 LLM 的智能分割與斷句,字幕閱讀更自然流暢

🔄 AI字幕多線程優化與翻譯,調整字幕格式、表達更地道專業

🎬 支持批量視頻字幕合成,提升處理效率

📝 直觀的字幕編輯查看界面,支持實時預覽和快捷編輯

🤖 消耗模型 Token 少,且內置基礎 LLM 模型,保證開箱即用

Windows端

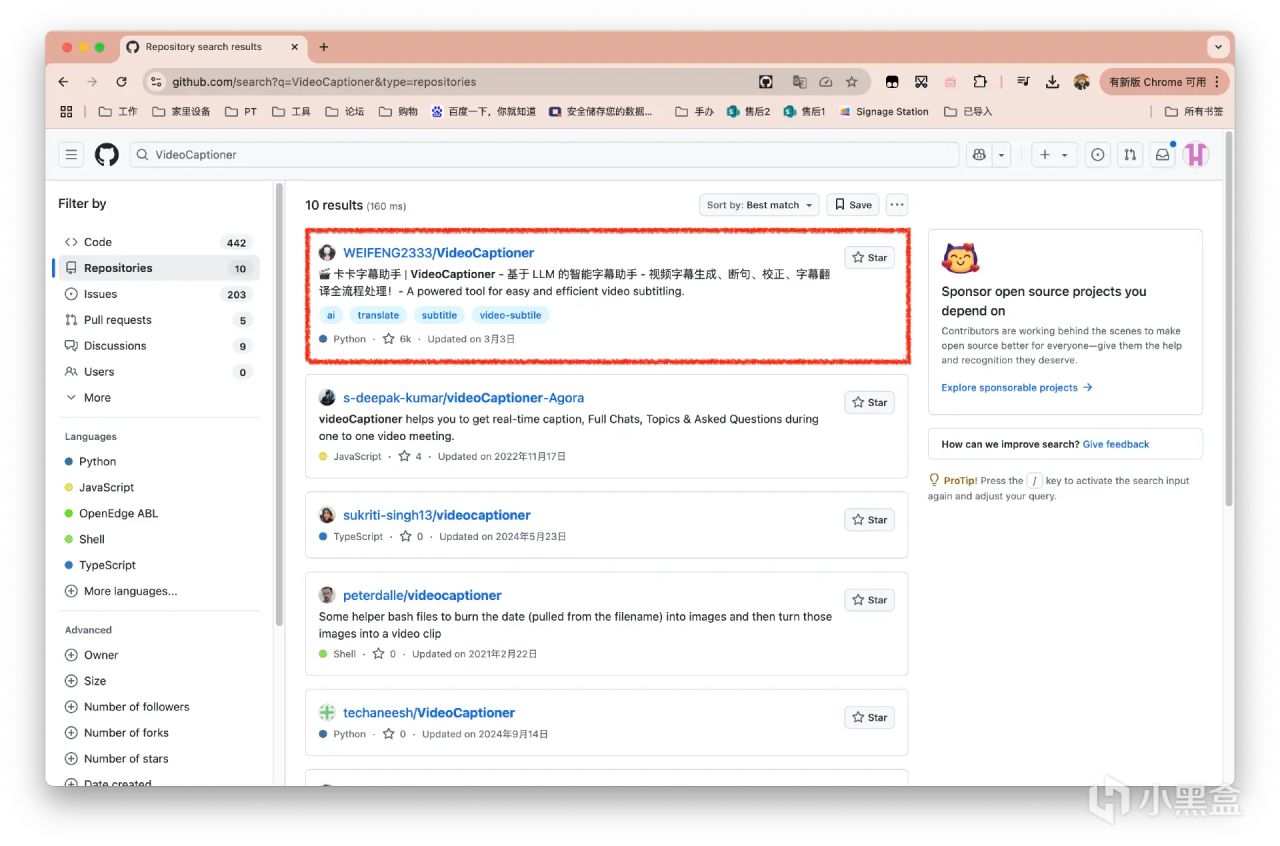

打開GHUB,搜索VideoCaptioner。

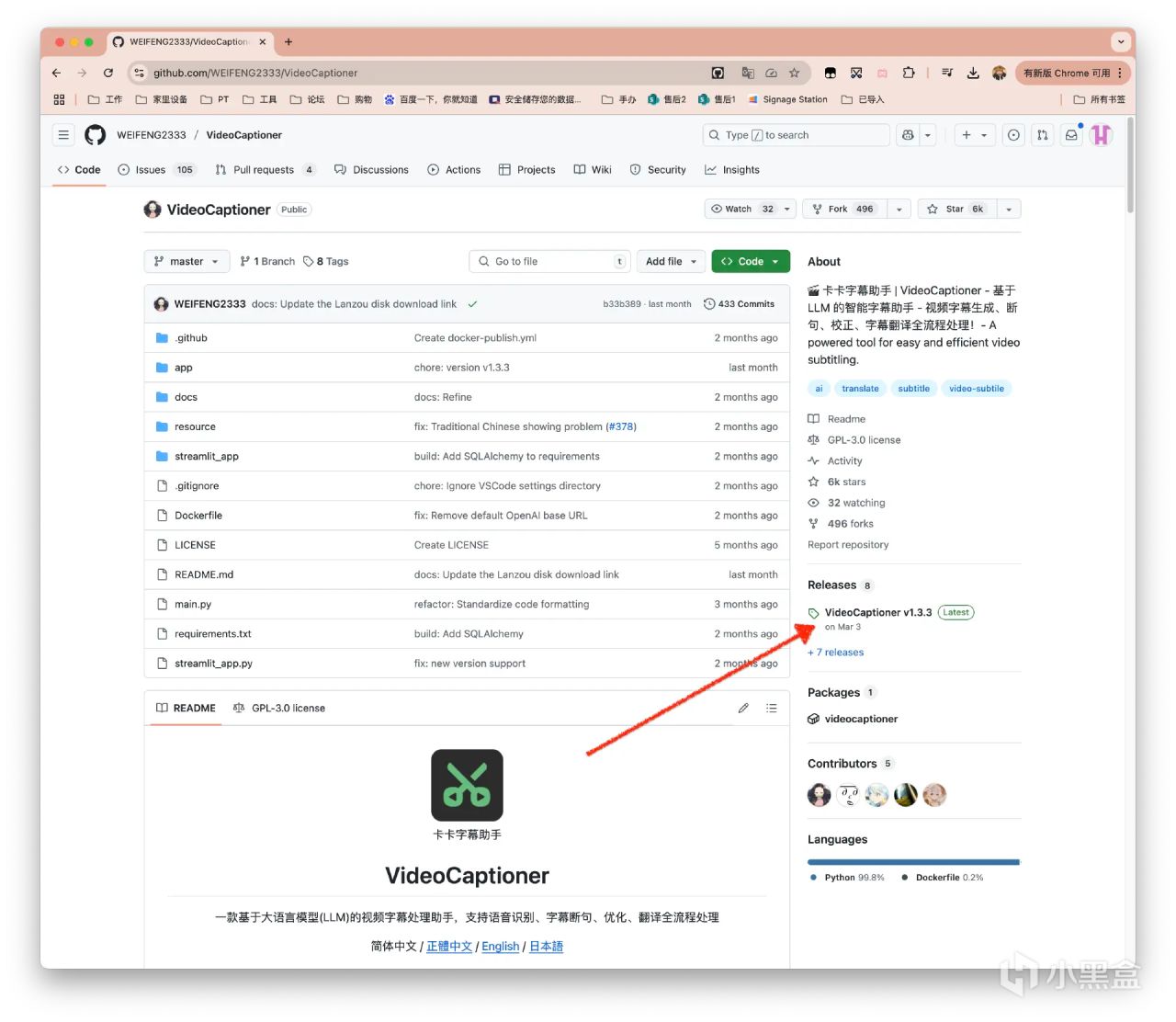

項目主頁,點擊下圖箭頭所示。

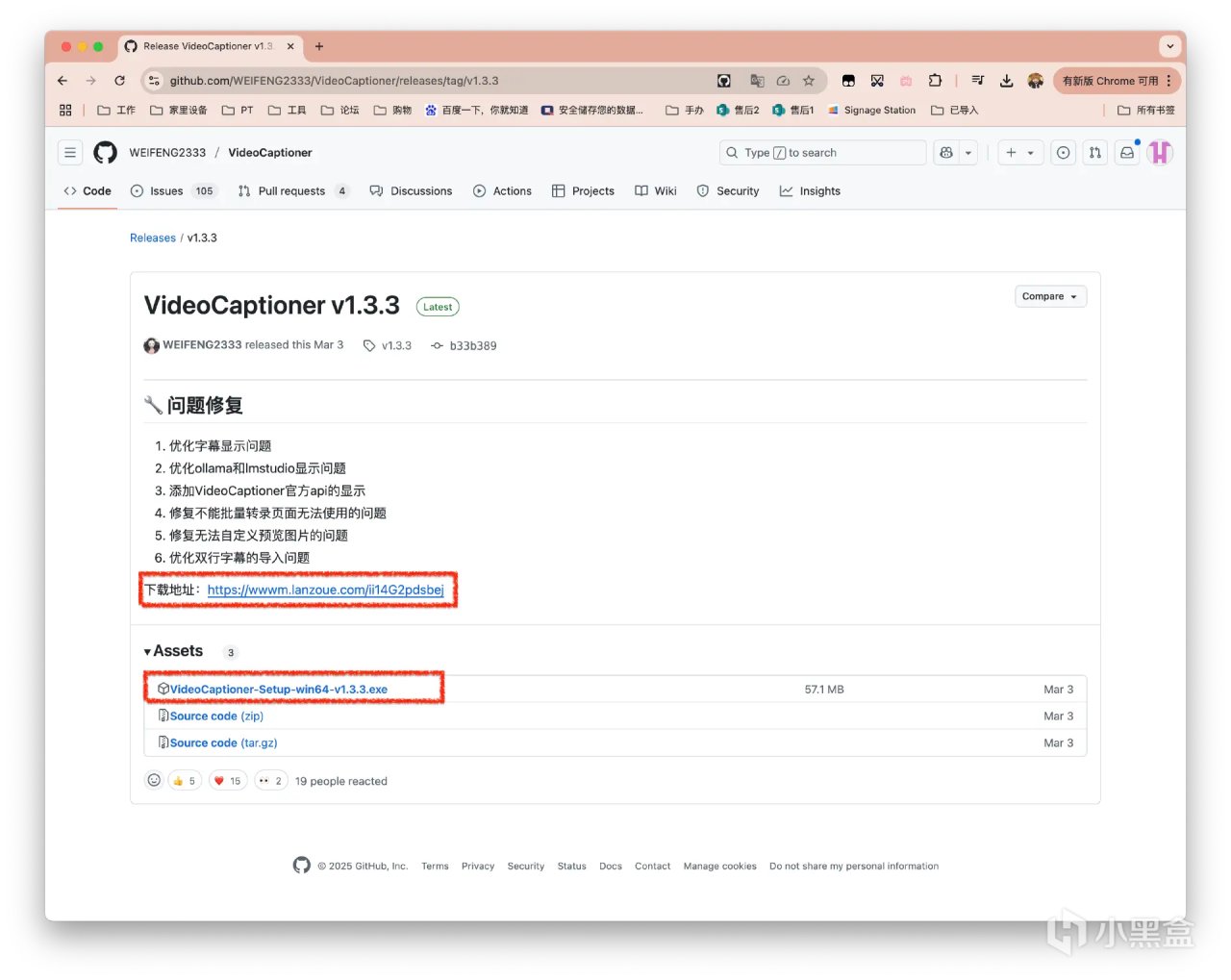

作者提拱了藍奏雲和直接下載,根據自己的情況哪個快用哪個。

下載完畢後安裝即可。

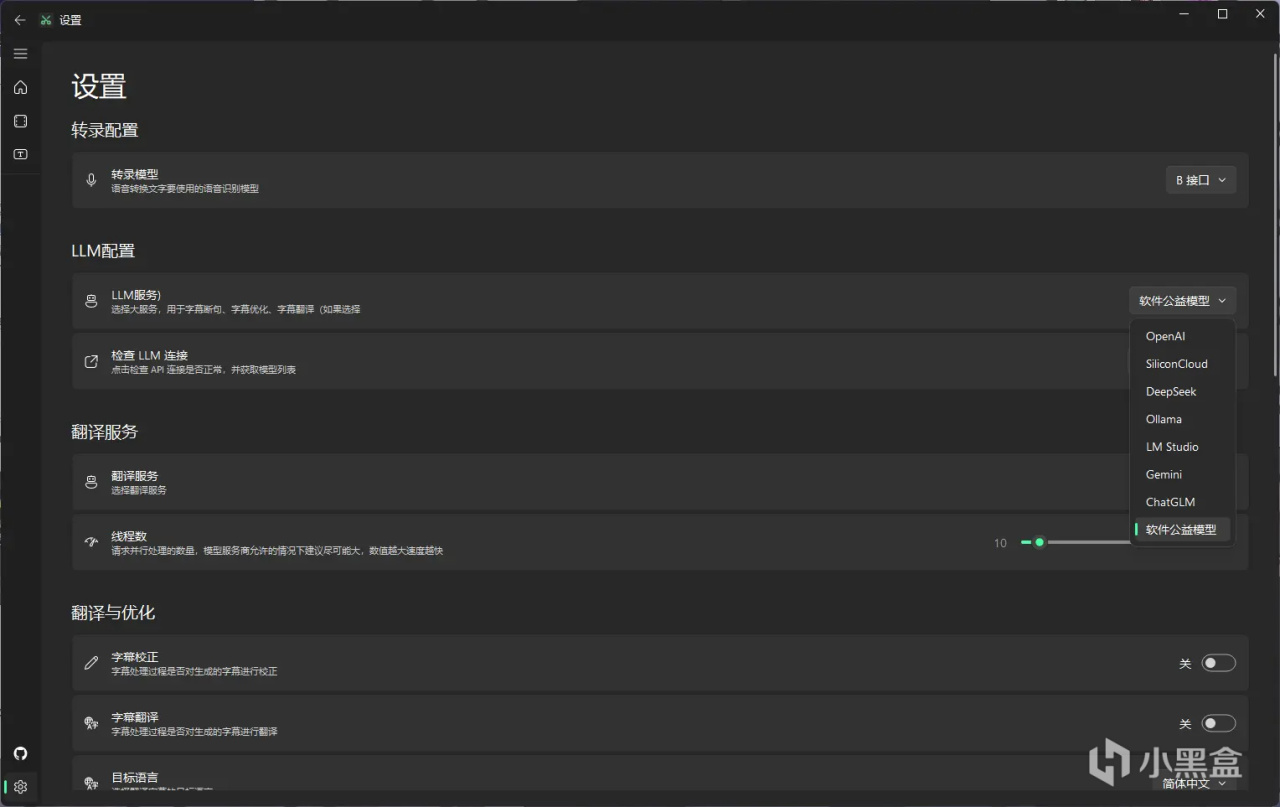

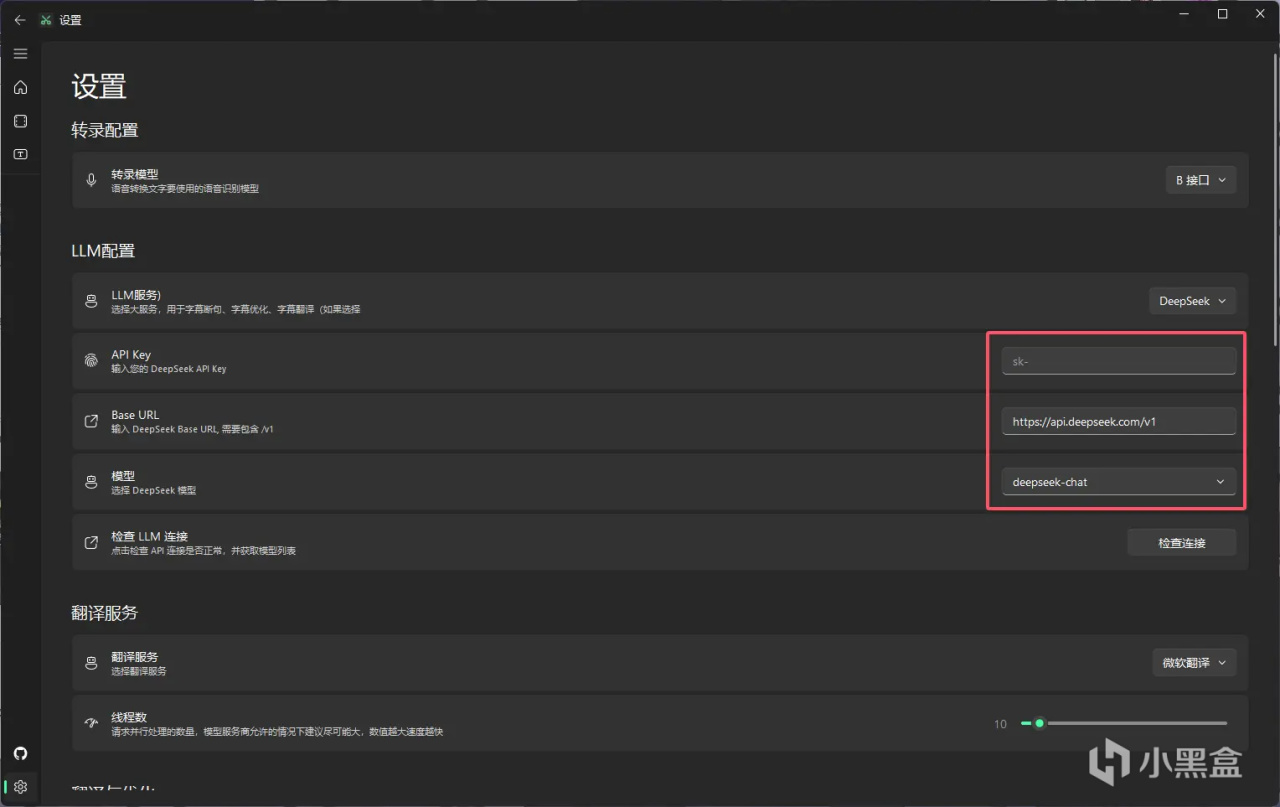

功能眼花繚亂,使用前可以先配置大模型,主流的Ai都已經支持,包括DeepSeek。

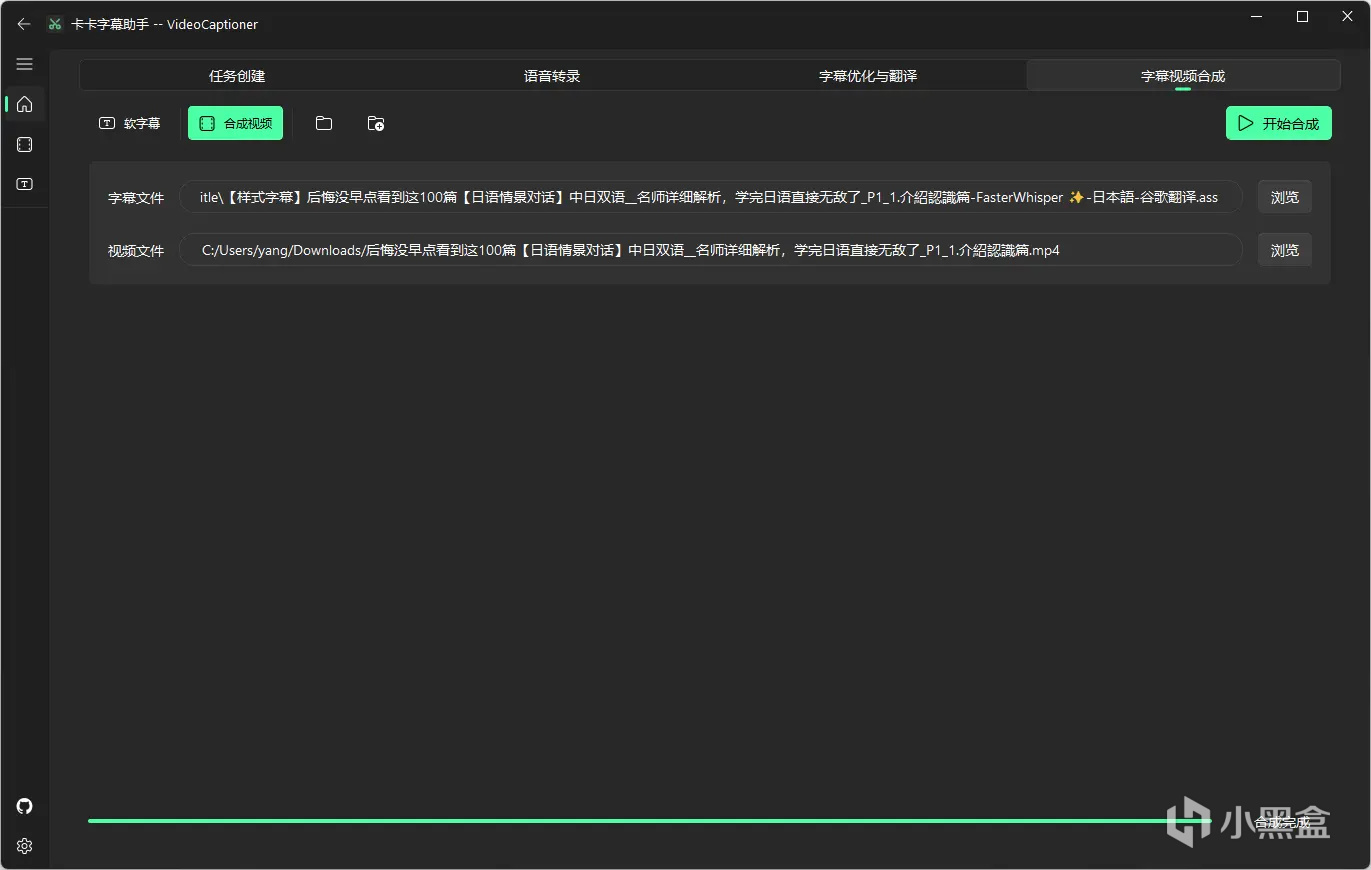

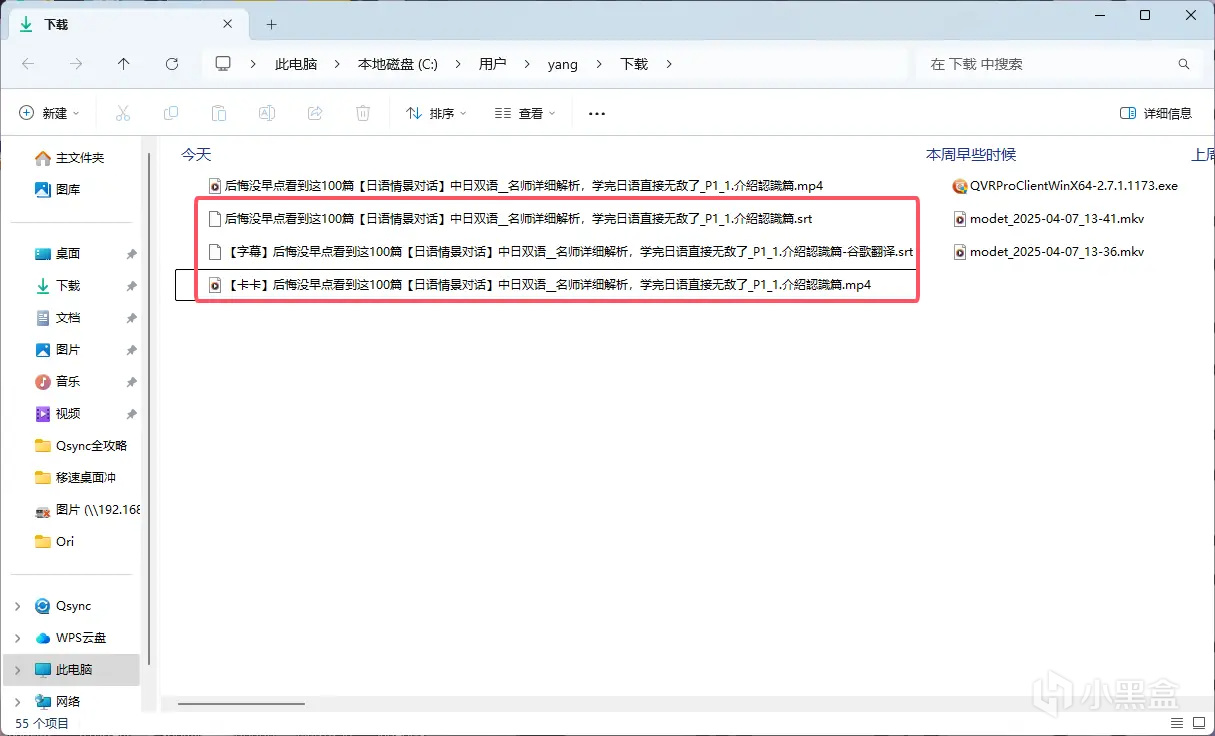

支持全自動一條龍:視頻語音識別-生成字幕-字幕翻譯-自動合成視頻。我們也可以不選一條龍,手動對字幕先行校對以獲得更好的最終效果。

第二個文件是語音識別提取的字幕文件,第三個文件是翻譯後的字幕文件,第四個是自動合成字幕的成品視頻。完全OK。

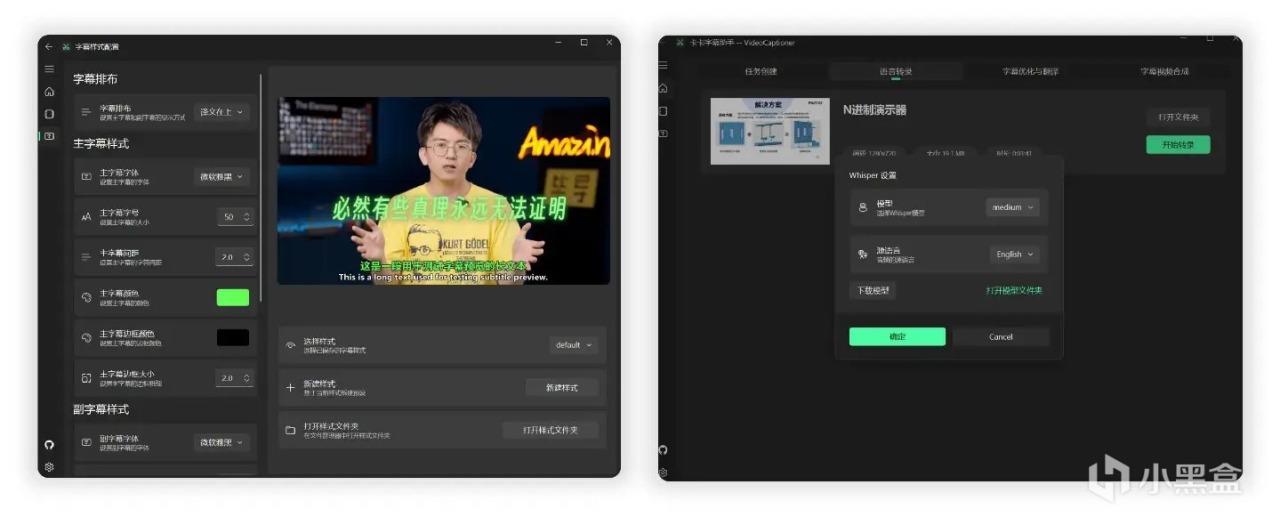

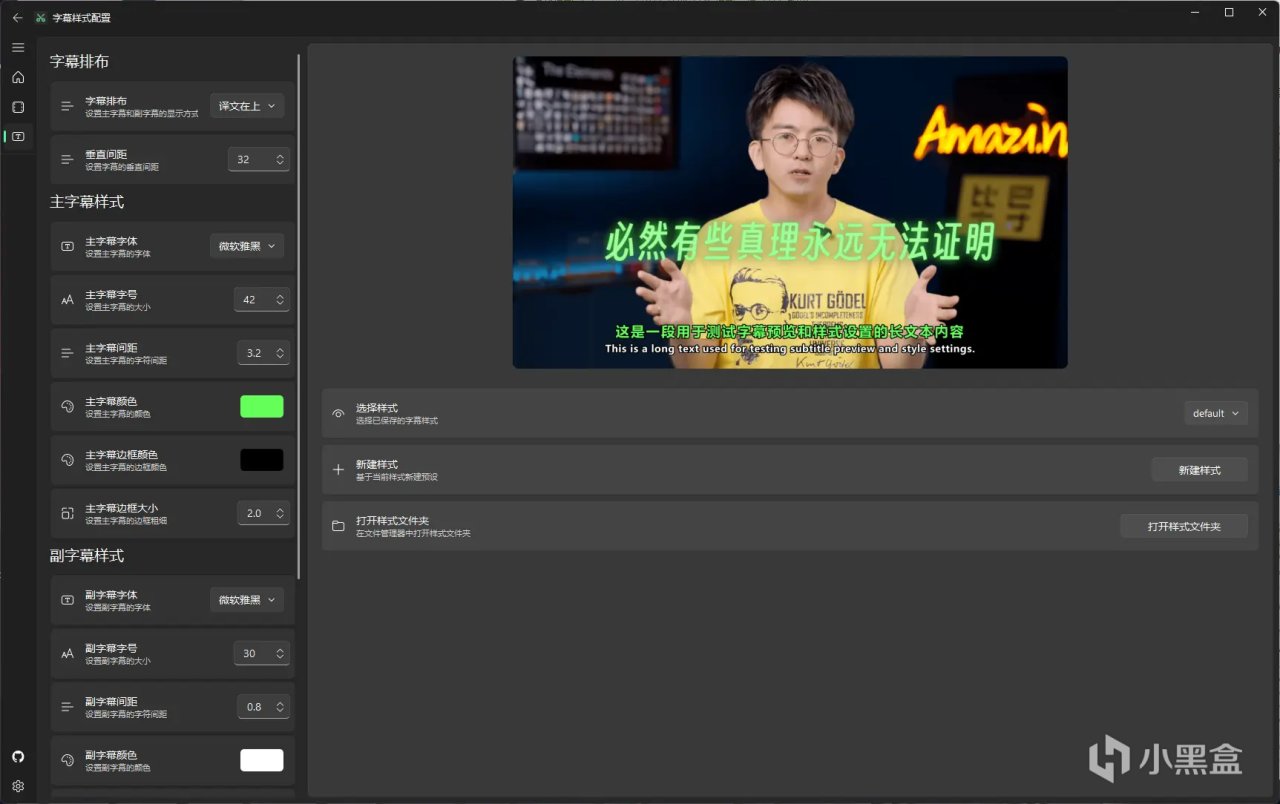

如果想要調整字幕的格式,樣式,可以到字幕樣式排布部分進行單獨設計。

Docker部署和使用

Docker版本輕量,可以應急用用來提取中英文字幕以及進行多語言字幕翻譯,完整體驗建議還是下載Windows客戶端。

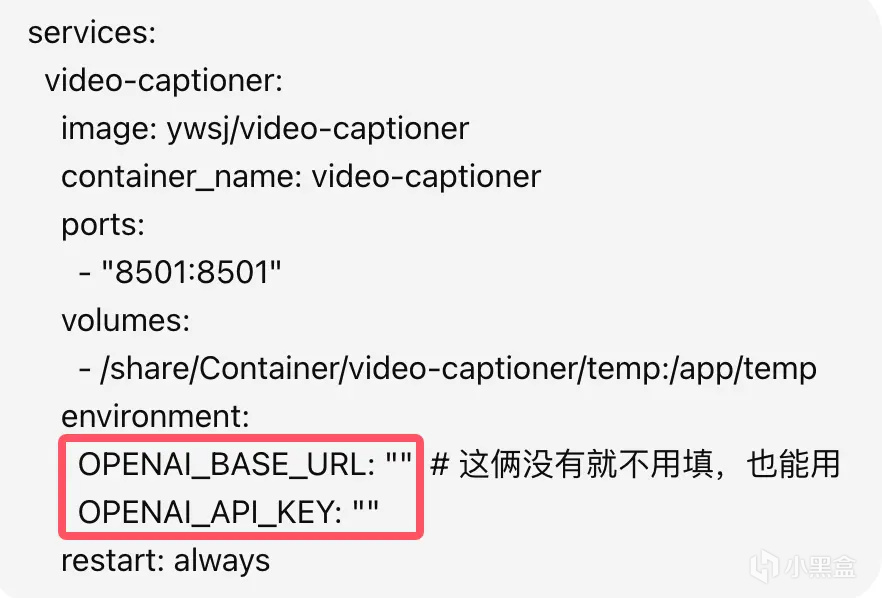

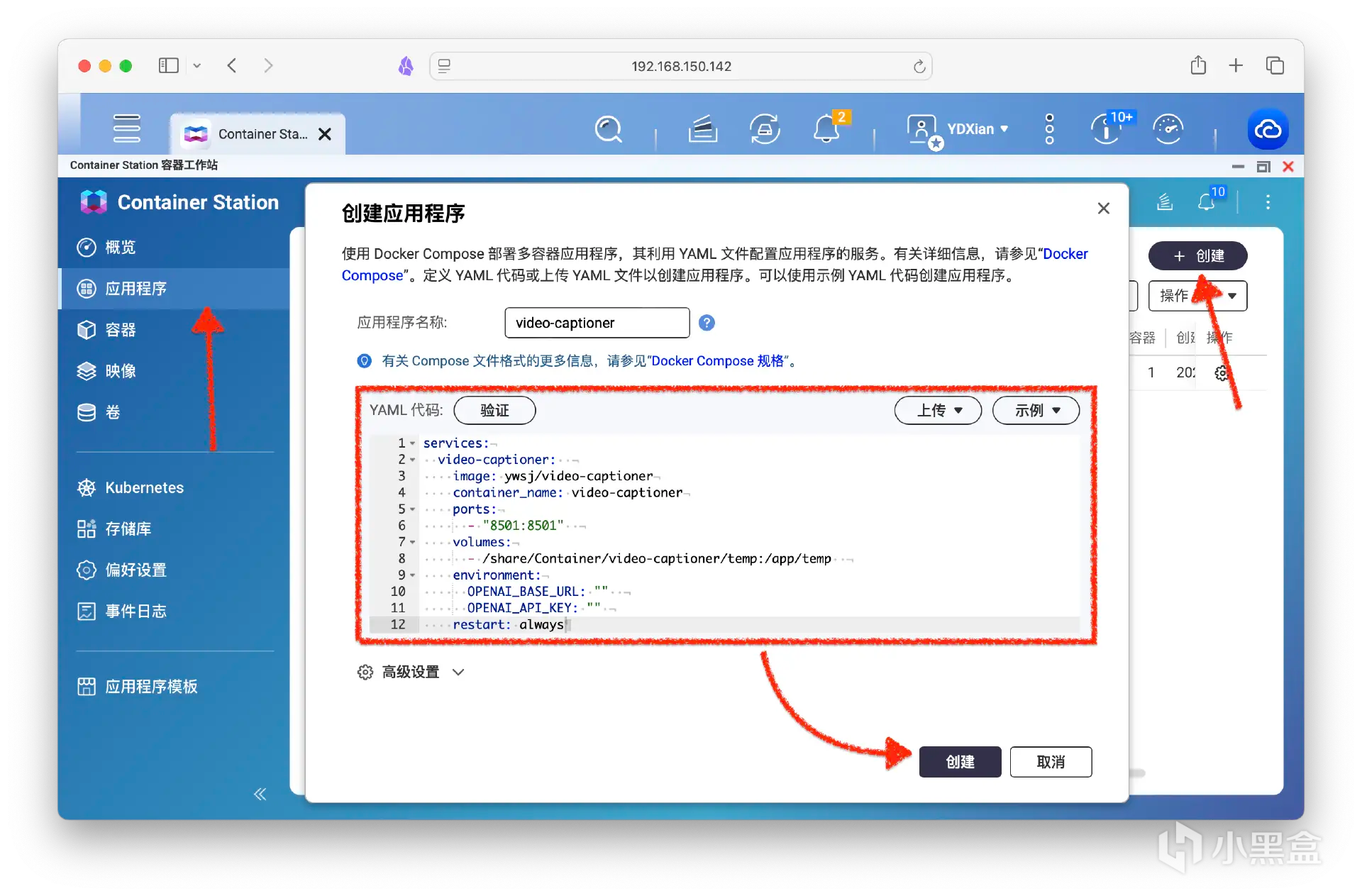

以威聯通NAS爲例,通過Docker Compose一鍵部署。黑盒這邊不支持插入代碼,大家參考一下圖片注意格式對齊。

services:

video-captioner:

image: ywsj/video-captioner

container_name: video-captioner

ports:

- "8501:8501"

volumes:

- /share/Container/video-captioner/temp:/app/temp

environment:

restart: always

環境變量這倆可以自行補上。

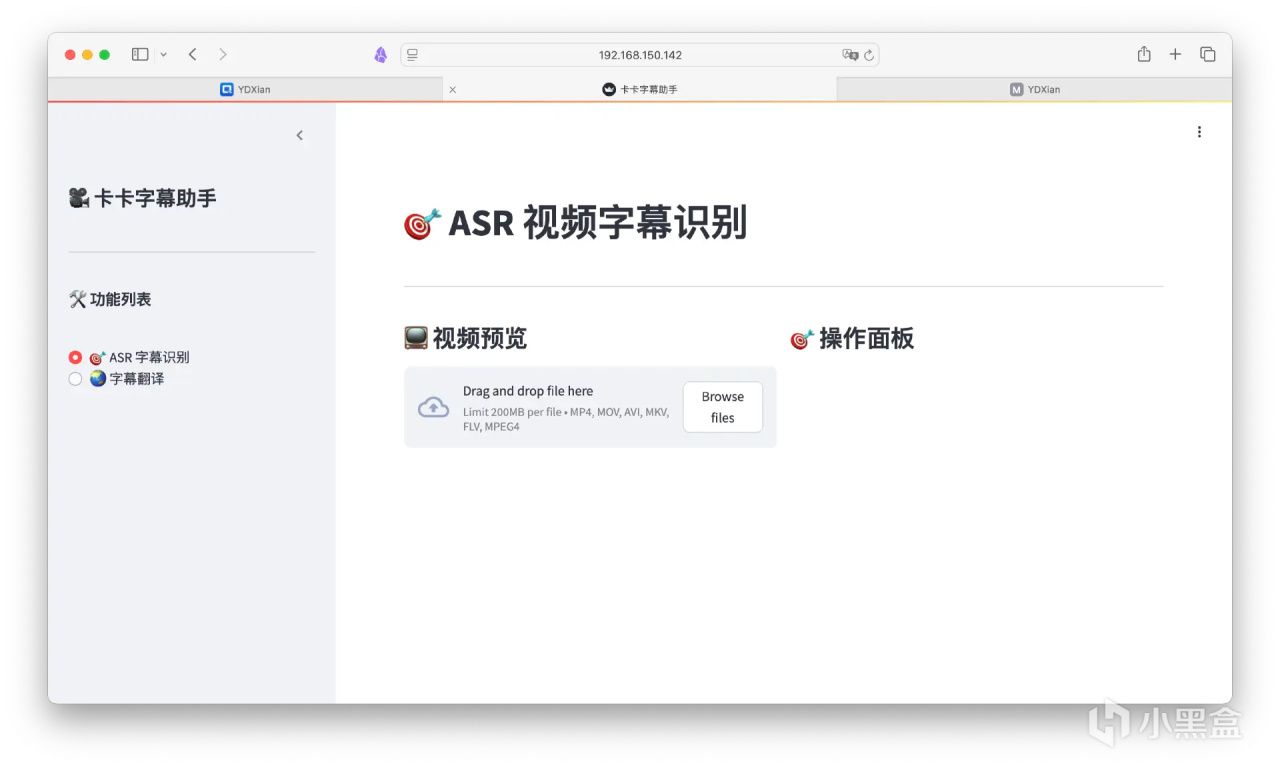

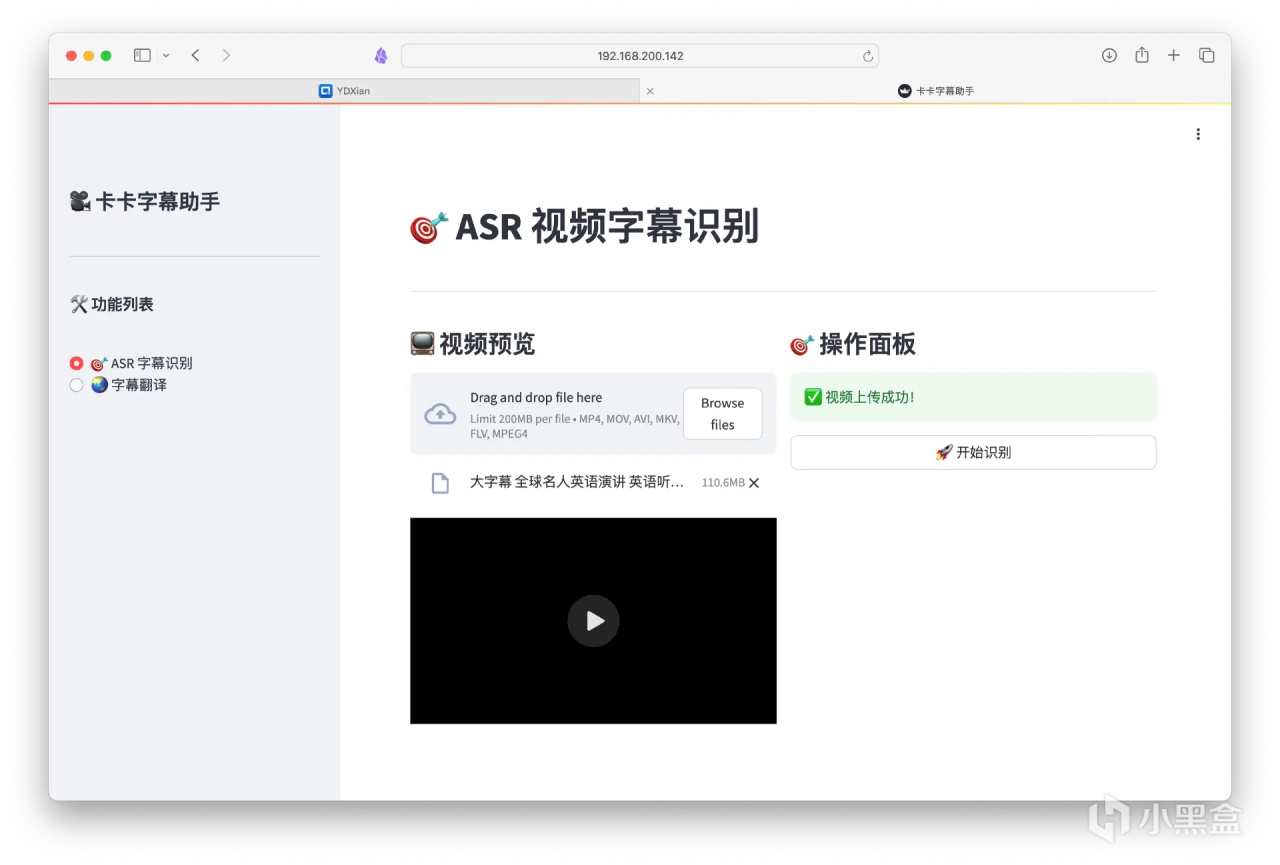

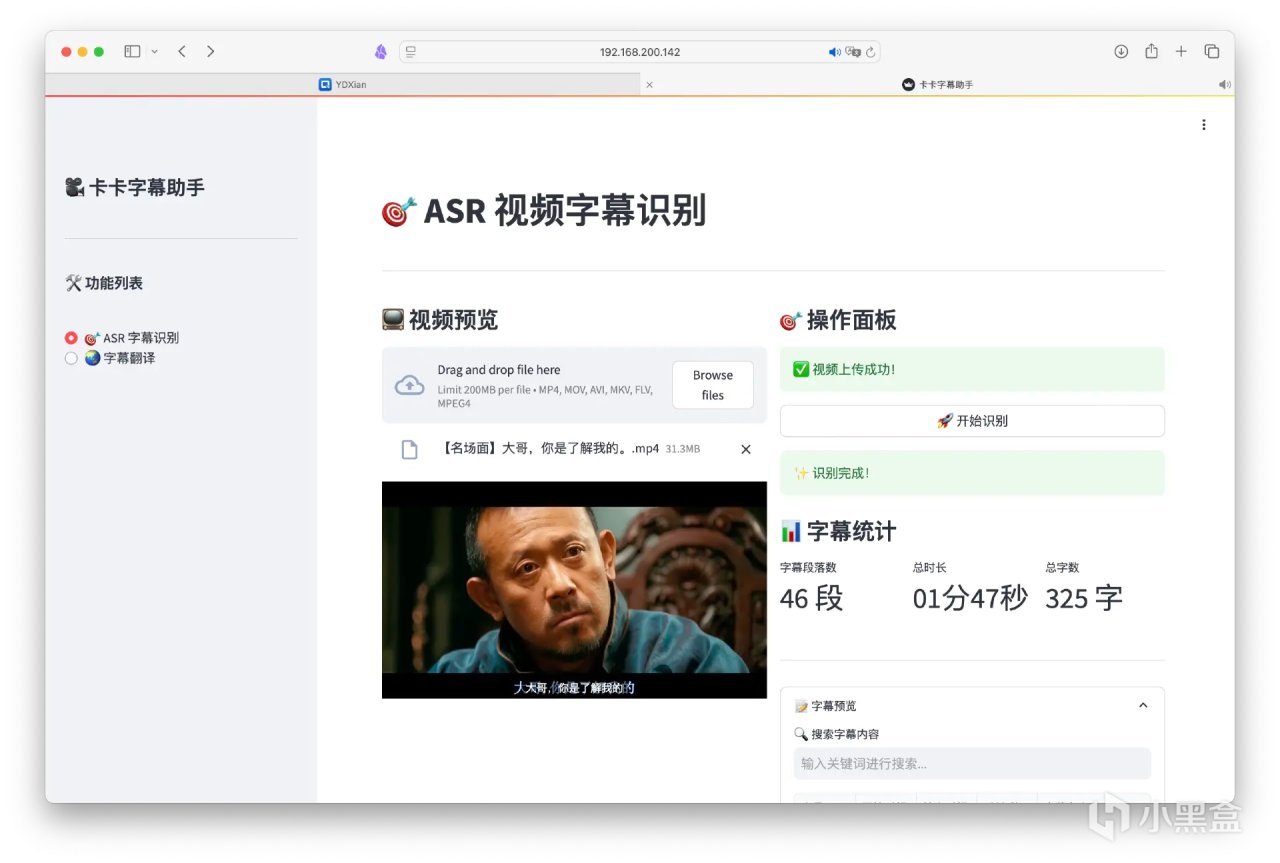

如上文,web輸入NAS_IP:8501即可訪問服務。

支持大部分的視頻格式。

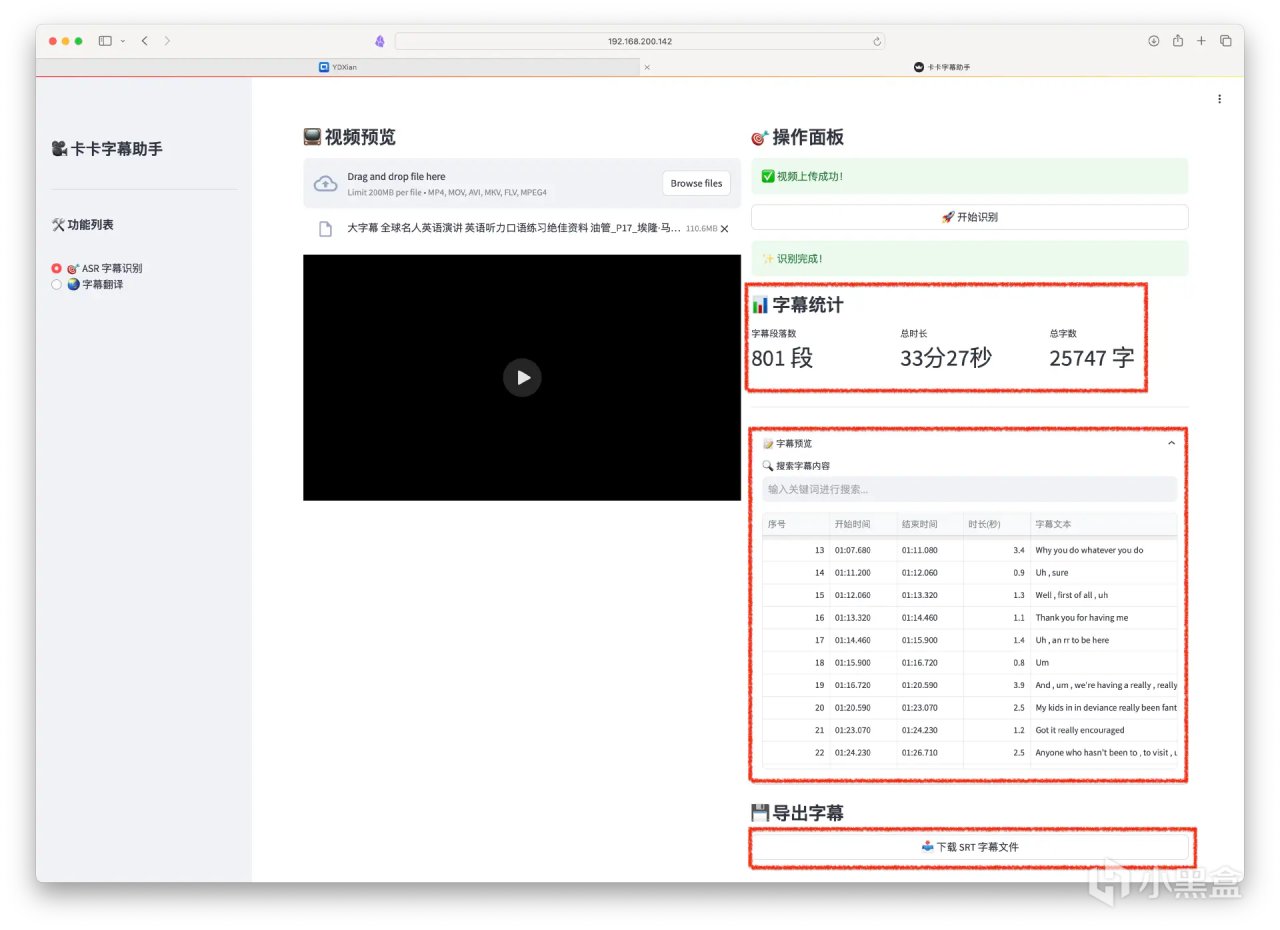

找了一個著名人士演講系列視頻,上傳上去,等待提示上傳成功。點擊開始識別。

能夠自動分段,支持字數統計,可根據單詞定位進度條。

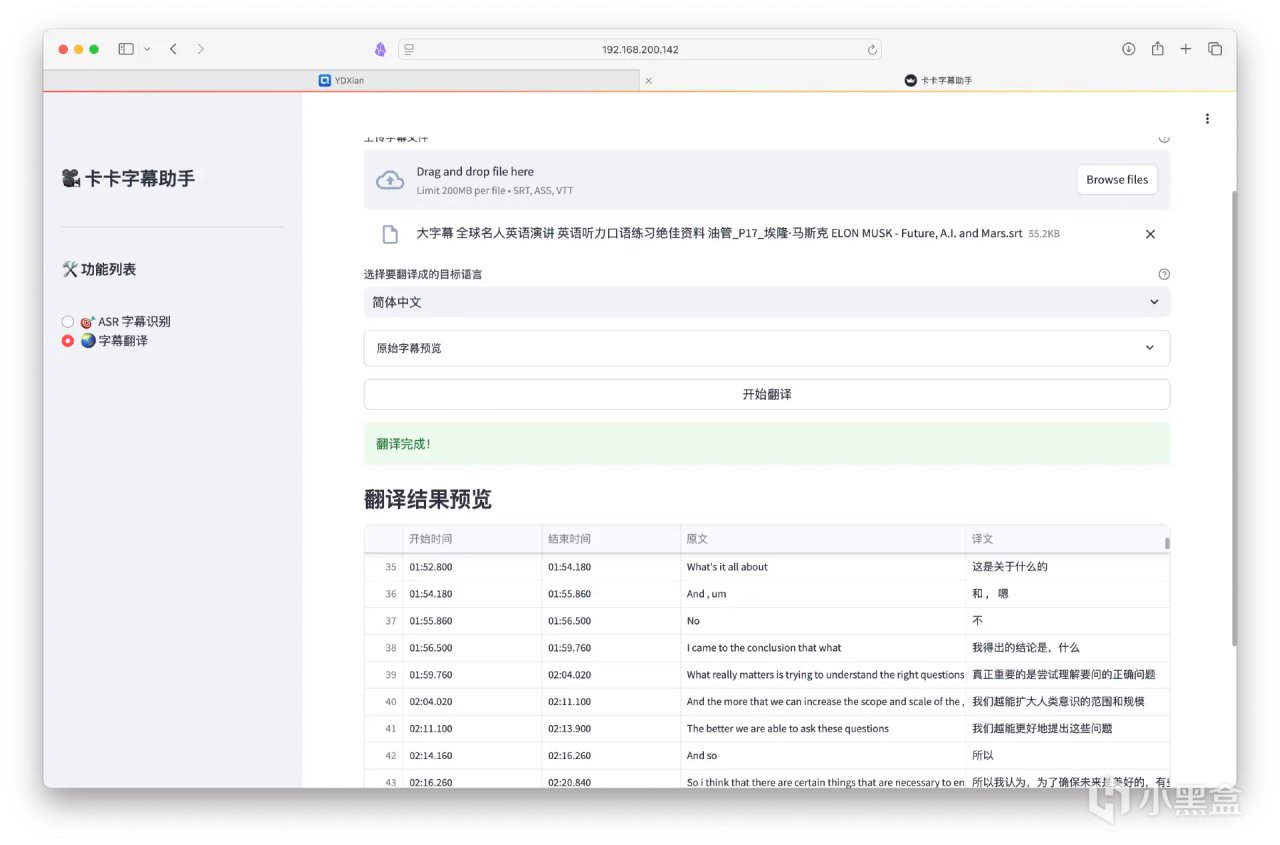

上面導出字幕後,可以直接用第二個功能進行字幕翻譯成我們的母語。

目前翻譯支持英語、簡體中文、繁體中文、日本語、韓語、粵語、法語、德語、西班牙語、俄語、土耳其語、葡萄牙語。注意,是字幕翻譯,字幕識別就中英文好用。

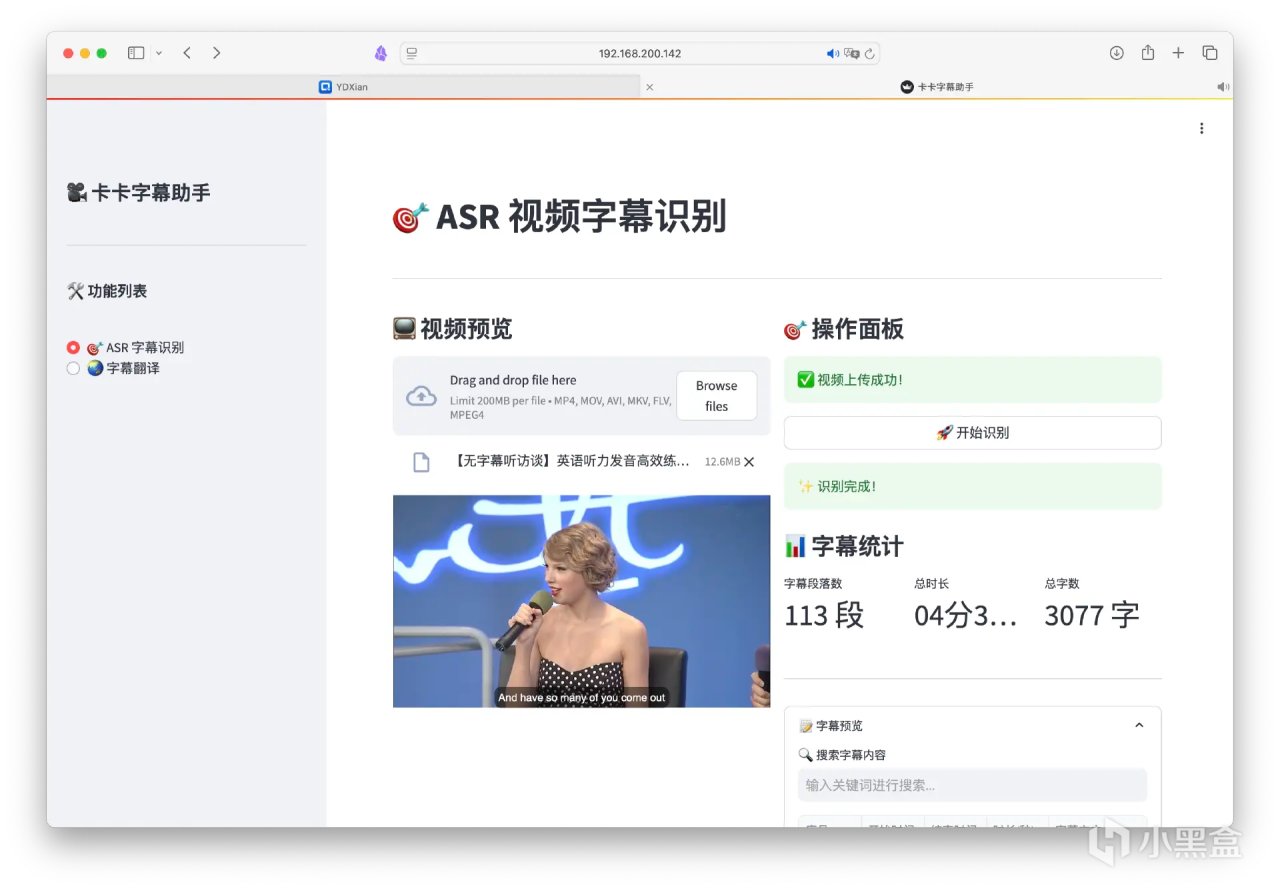

又測試了一段黴黴採訪。

中文普通話測試也沒問題,帶點地方口音也都能準確識別,但是像那種鬼畜魔音就不行啦。

總體的準確率還可以,爲了提升準確率,有條件的可以補充上那兩個環境變量。

更多遊戲資訊請關註:電玩幫遊戲資訊專區

電玩幫圖文攻略 www.vgover.com