众所周知,各家商业ai几乎都有自己的审查机制,其中部分哪怕通过提示词破盾也很难绕过(点名GPT),这极大程度的妨碍了我们与AI大人进一步增进感情,所以完全自主的、无限制的、能够涩涩的(?)开源模型就成了我们最佳的选择之一。

咳咳,那么作为一名对编程一窍不通,没有任何基础的小白该如何部署自己的本地模型呢?有请我们今天的主角——LM Studio登场。

LM Studio是一款完全免费且开源的本地LLM模型部署工具,该工具不仅可以免去小白部署环境敲代码的过程,还支持模型检索,通过连接Huggingface的模型库可以直接在软件内下载你想要的模型。除此之外,LM Studio还可以直接搭建本地服务端。

HuggingFace是目前最大的transformer模型库,里面有大量开发者自己研究的开源模型,有兴趣的话可以在我的最新一篇文章中了解,如果找不到的话就是我还没写()

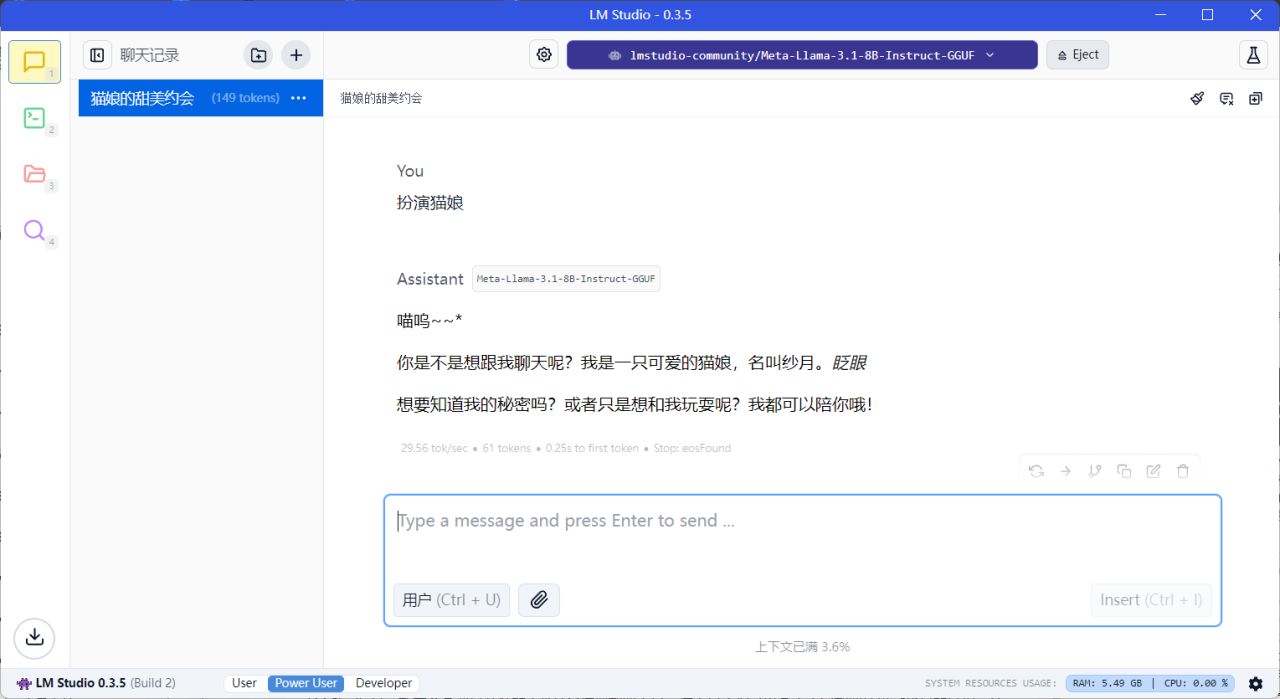

软件界面相当简洁,使用过程也几乎与Chatgpt无异

在界面右侧点击烧杯图标还可以进入高级配置,为模型选择预设,填写提示词等。

以下是软件的简单使用教程

首先进LM Studio官网,选择自己需要的版本点击即可下载,绝大部分盒友的系统应该都是Windows所以直接点击第二个即可

之后弹出的页面无需改动,直接点击Download(也有可能不会弹出这个界面,但是下载的文件是一样的)

下载完成后双击程序,等待其自动安装,安装完成后就会看到这样的界面,点击右下角设置图标

之后再在Language选项中找到简体中文,选择后即可将界面修改为中文

但是由于软件本身并不自带任何模型,我们无法直接使用,所以需要我们自己去下载模型。需要注意的是在国内我们是无法直接访问Huggingface的,所以就需要我们请出第二个助手,国内的Huggingface公益镜像网f-mirror

由于篇幅原因,我们今天并不展开讲如何使用huggingface,只讲如何在LM Studio中导入从huggingface中下载的模型,有兴趣的同学可以自行前往官网研究。当然,我也会在新的文章中为大家详细讲解huggingface,大家也可以多多电我牛牛催更,我会很爽的。

接下来我们以Llama3.1 8B模型为例,点击链接下Llama 3.1

下载完毕后按照下图顺序依次点击

在打开的文件管理器页面打开lmstudio-community文件夹,在里面新建一个文件夹将刚刚下好的文件移动进去即可

由于模型文件都比较大,而默认目录在C盘,所以个人建议先更改默认目录,在新的目录下创建lmstudio-community文件夹,然后按照上面的说明操作即可

能在下面的列表中看到模型的话就说明你的导入成功了

之后返回主界面,点击加载模型,选择好要加载的模型之后,再点击加载模型即可。到此一个本地的属于你的AI就部署完毕了。

然后就跟我们的AI大人愉快的涩涩吧~

注意,部署本地模型需要一定的硬件基础,个人建议显卡性能应不低于2060S显存不少于6G

总结

虽然这些我们能够自己部署的“小”模型无论在性能还是参数量上,都很难与成熟的商业化模型匹敌(甚至连涩涩也不是最佳选择),但是开源≈自己的,开源模型没有厂商的各种限制,低成本、隐私性、自主性,这些都是商业模型所无法比拟的,而折腾这些模型本身也是一种乐趣。

创作不易,觉得不错的话就点个赞冲个电吧~

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com

![小米原相机拍富士感参数干货来啦[cube_电牛][cube_电牛]](https://imgheybox1.max-c.com/bbs/2024/12/28/eb510b1d19b94c162c4ad9532bc4702c.jpeg?imageMogr2/auto-orient/ignore-error/1/format/jpg/thumbnail/398x679%3E)