在今年年初,AI圈子投下了一颗大炸弹,由国内团队研发的DeepSeek-R1大语言模型横空出世,并且公布即开源,其性能堪比甚至超越不开源的OpenAIo1,同时造价成本并不高,对比国外高额的预算,可以说是用偏少的算力,造出了媲美当今最强的大预言模型,并且免费开源,交给了全世界。

那么想正常使用DeepSeek,大家只要上官网直接使用即可,但因为DeepSeek火遍全球大江南北,服务器24小时高强度负载,导致无论白天黑夜都有大概率出现服务器繁忙无法正常使用的时候,这时候就显得本地部署非常重要了。

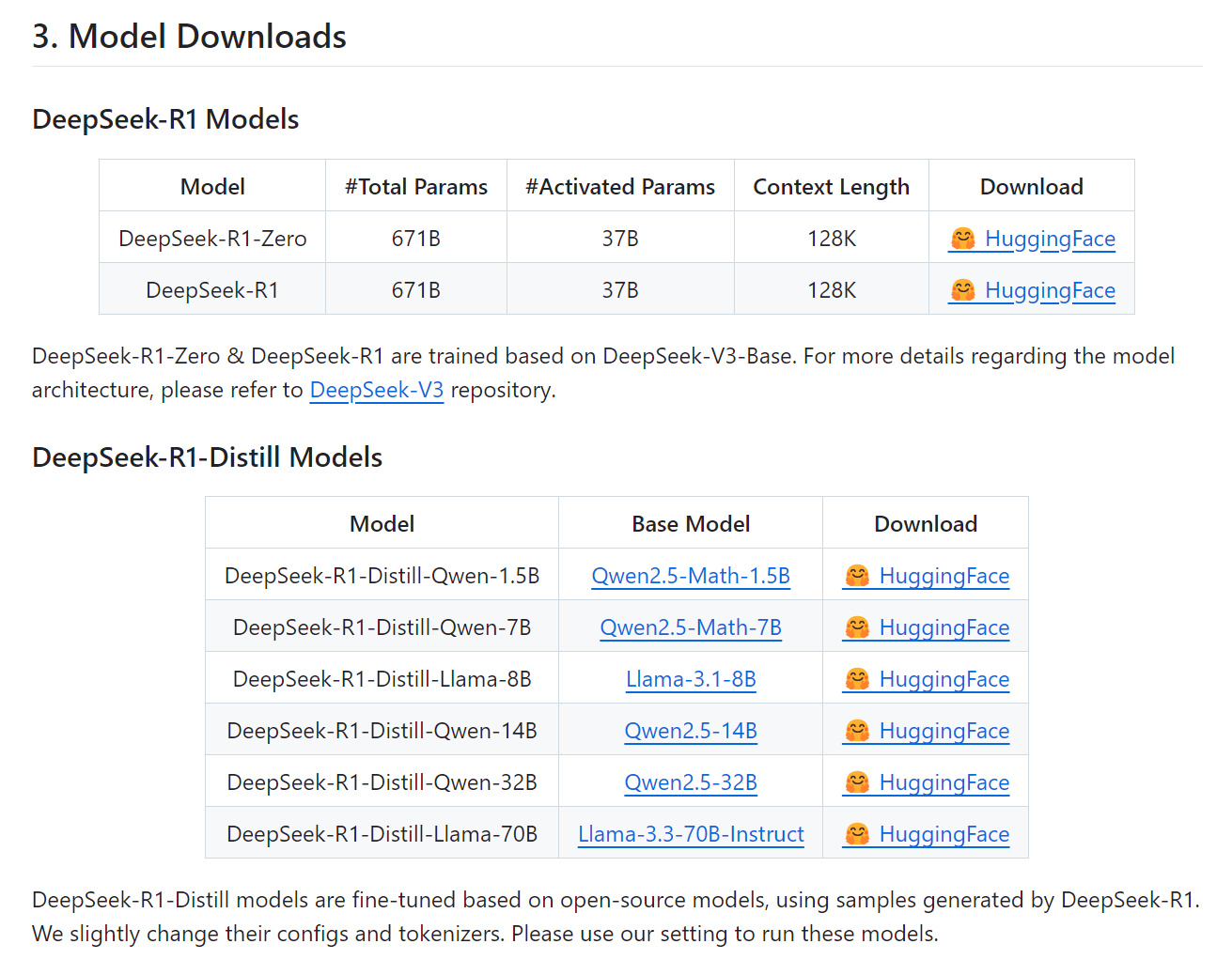

而本地部署除了网络原因外,主要也是有着本地布置私人助手的需求,或者是不想信息泄露,以及在一些没网络的机器上部署,都有着各式各样的原因。而官方原生模型为671B模型,对于显卡显存的需求高达320G以上,正常人基本无法体验,但官方贴心的放出了蒸馏版本,通过量化技术将模型进行压缩,分成了不同需求的版本。

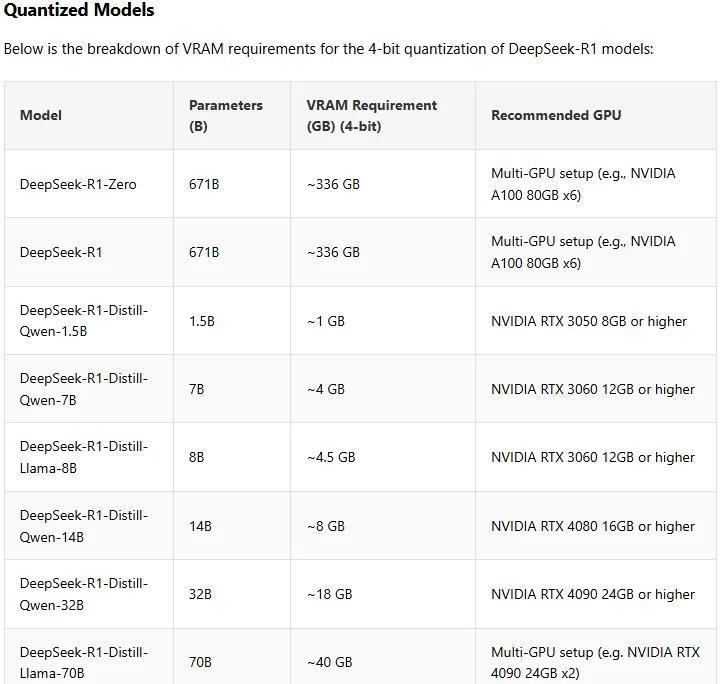

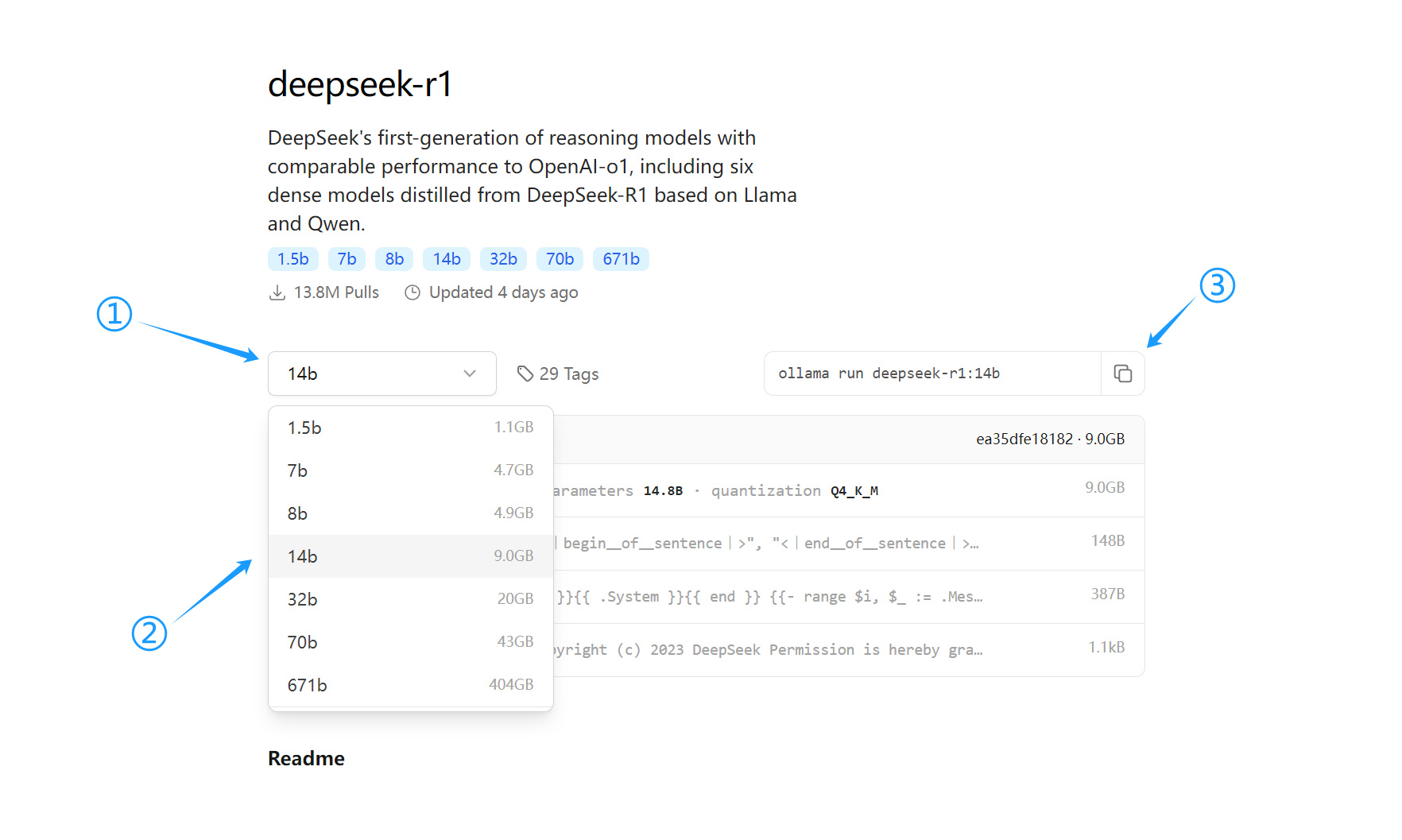

本次就先介绍如何在PC端安装DeepSeek-R1,在本地安装前,先选择适合自己的模型大小,显存1GB以上的,先择1.5B大小的DeepSeek-R1模型,显存4GB以上的,选择7B或8B大小的DeepSeek-R1模型,显存8G以上则是14B,显存达到18GB则是32B模型,目前消费级显卡最高的5090D,也只不过能使用32B大小的模型,不过显存达不到需求也可以试试,只不过响应速度会慢很多。

比如我使用RTX5080金属大师OC显卡,它的显存大小是16GB,那么就选择14B大小的量化DeepSeek-R1模型。首先我们得下一个ollama框架,打开ollama官网,点击下载windows客户端(系统至少是windows10及以上)。

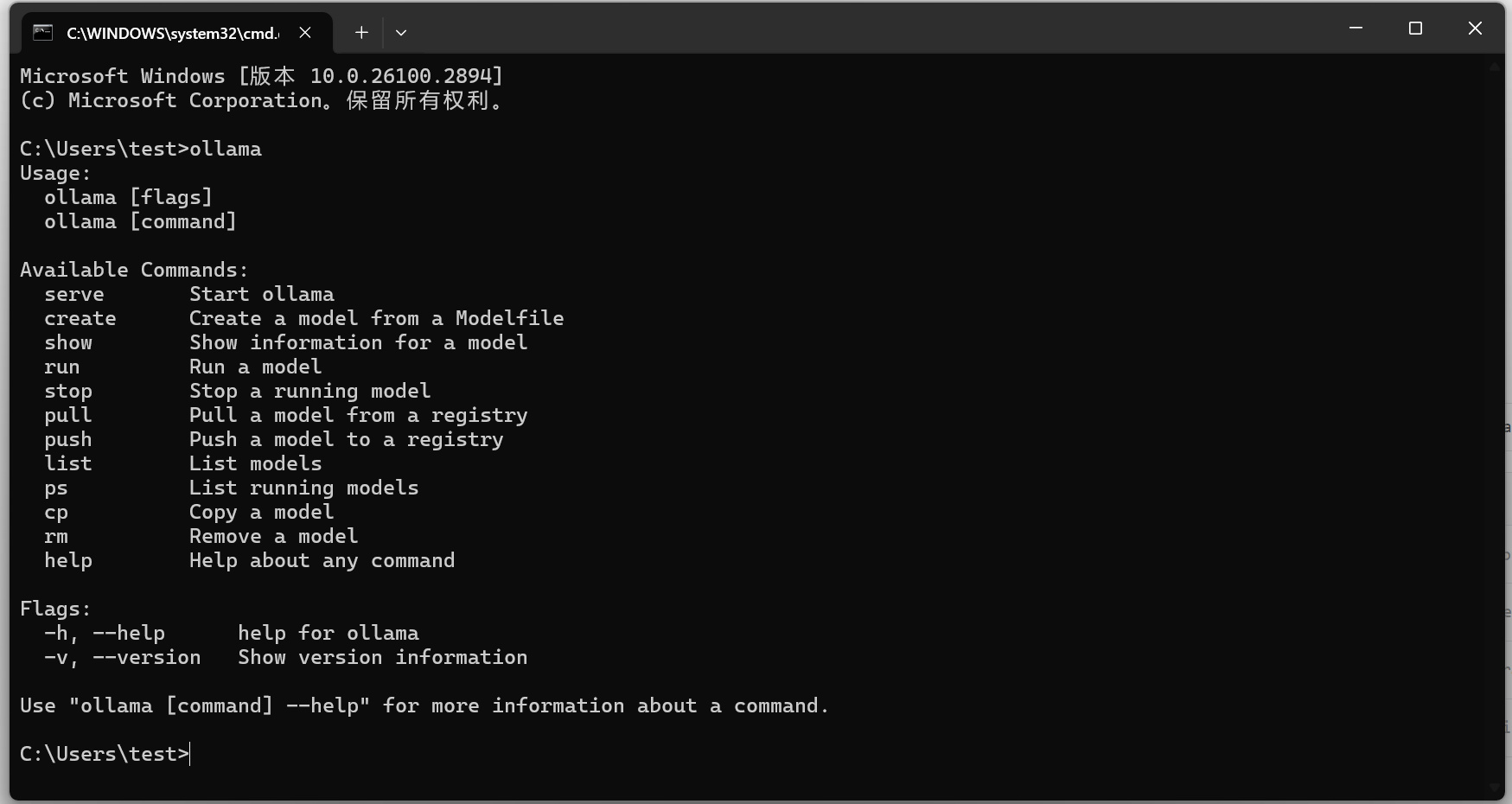

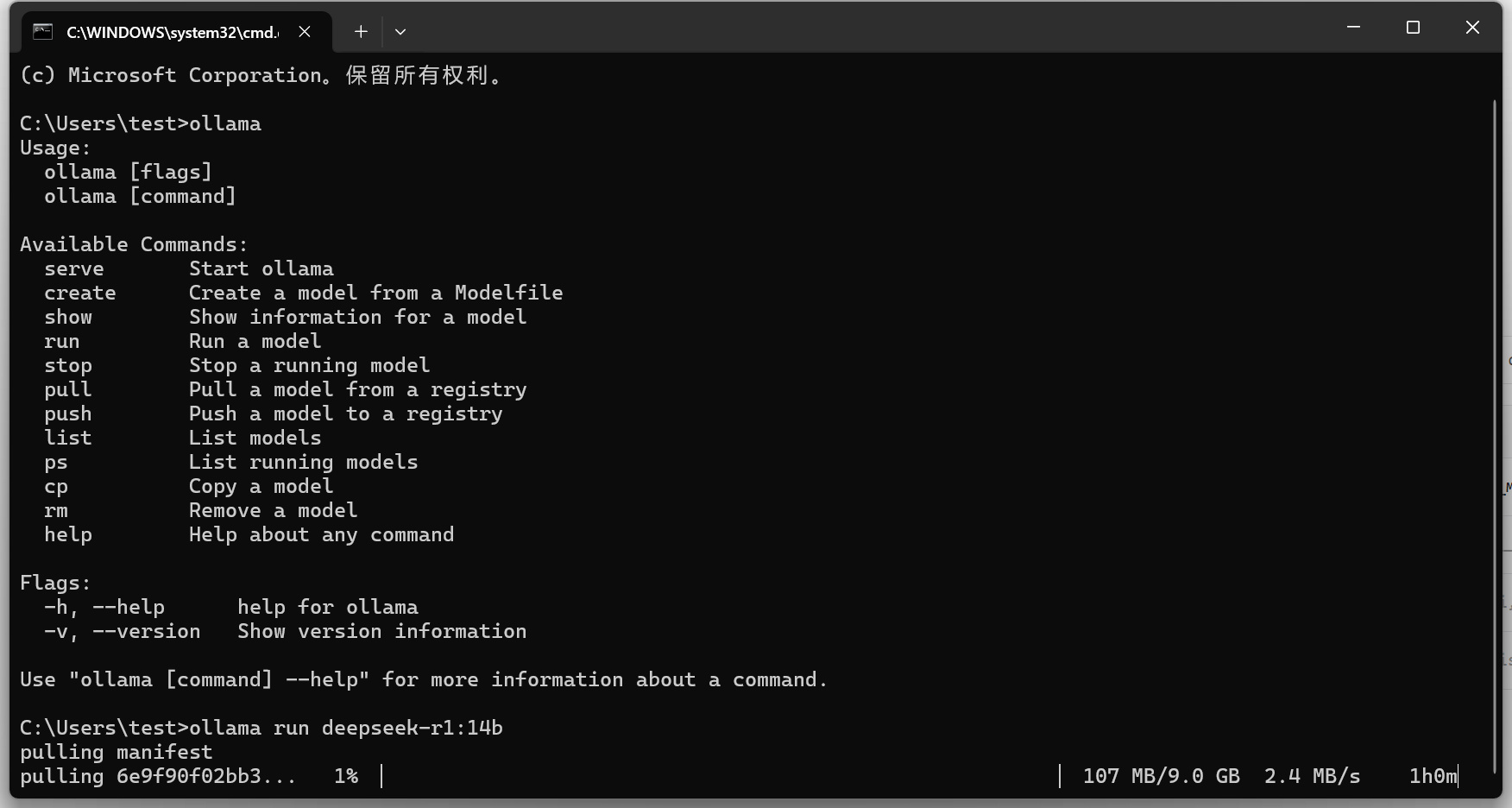

安装完ollama框架后,用win键+R键呼出运行,输入cmd打开命令行窗口,输入ollama,出现命令菜单就是安装成功了。

然后回到ollama官网,点击上方搜索栏搜索deepseek-r1,在左边选项框里选择你需要的模型大小,然后点击右边的复制按钮。

接下来回到命令行窗口,粘贴负责的代码(单击右键也可以粘贴),回车运行等待下载即可。此时下载卡顿的话,可以关掉命令行窗口再重新粘贴代码,回继续满速进行下载。下载完想验证下,可以在命令行窗口输入ollamalist查看模型。

如果下载好后使用,可以在命令行窗口中输入ollamarundeepseek-e1:14b回车,就可以进行啦,当然为了更多功能以及美观一些,更多人是推荐使用WebUI,比如Chrome浏览器里的插件PageAssist,可以更方便的使用模型。

以上就是本地部署DeepSeek-R1的一种办法啦,想尝试的小伙伴赶紧去试试,当然如果你想有着比较良好的AI体验,一张大显存显卡必不可少,而最新推出的影驰RTX5080 金属大师OC则是你的不二之选,拥有16GB的大显存,足够你作为体验AI的利器,并且RTX50系显卡拥有对AI更好的支持,TensorCore更是加速AI的好帮手,让你在AI探索道路上更加畅通无阻~

来源:中关村在线

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com